所有語言

分享

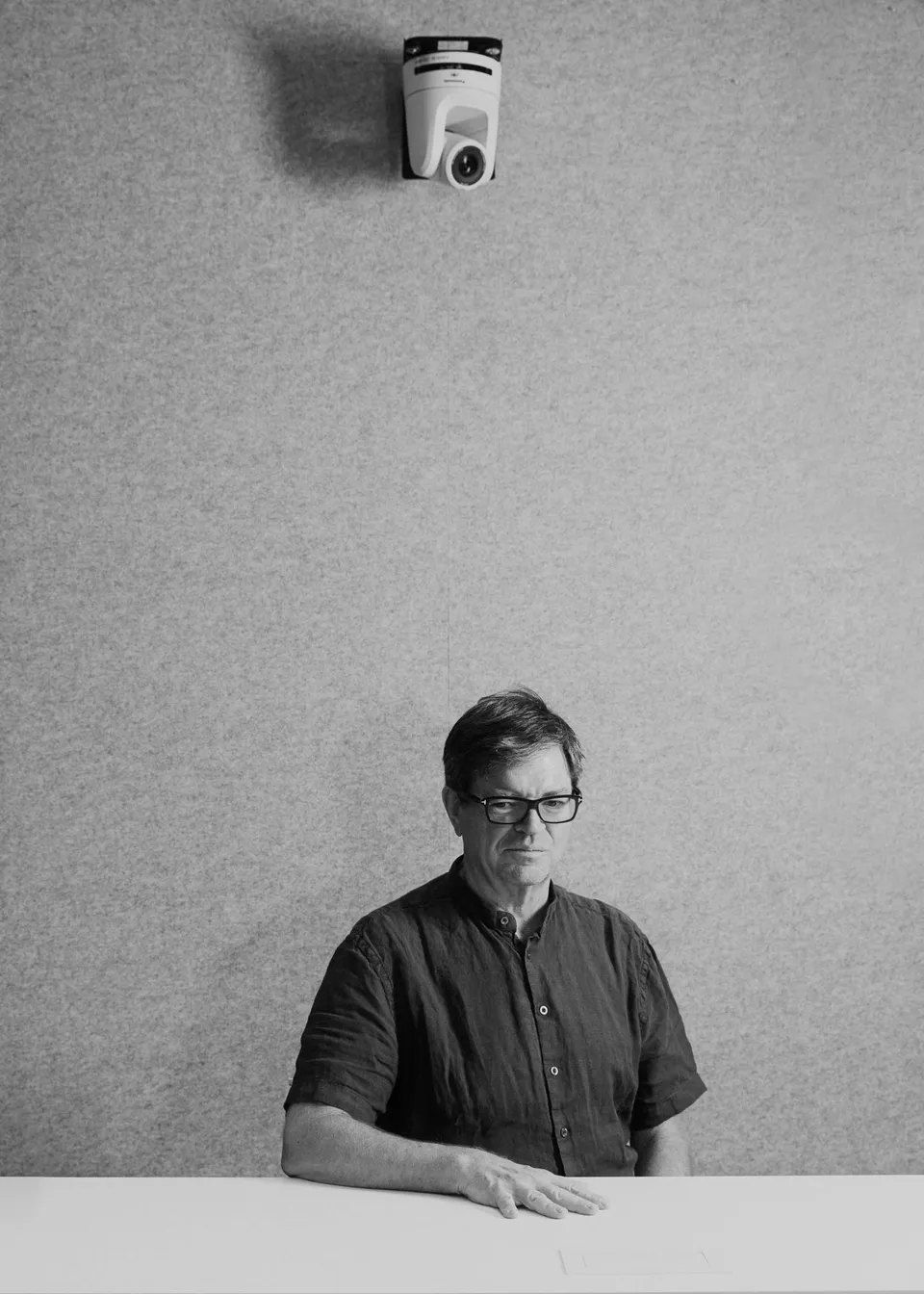

對話 Meta 首席科學家 LeCun:AI,爵士樂,開源 Llama 的初衷

原文來源:深思SenseAI

圖片來源:由無界 AI生成

在當今快速發展的大模型領域,伴隨技術進步的步伐,也湧現了許多關於其能力和影響的誤解和爭議,因此深入理解這一技術的未來發展路徑和潛在影響至關重要。Yann LeCun,作為深度學習領域的奠基人之一和 Meta 公司的首席 AI 科學家,對於 llama 的開源有着重要影響。

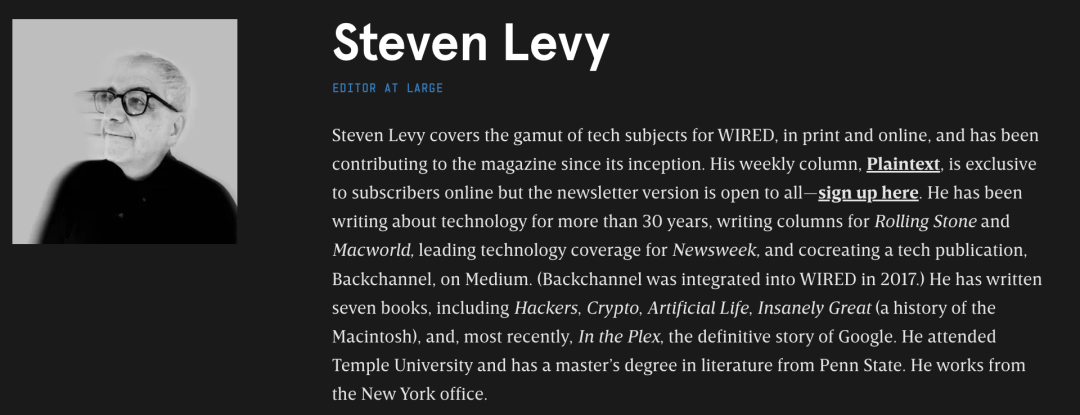

本文整理了 LeCun 的最新訪談,由曾多次採訪過喬布斯的著名科技和搖滾樂記者 Steven Levy 訪談,內容包括 LeCun 對 AI 發展的看法,特別是 AI 發展潛力、AI 開源的必要性和安全保障措施,以及 AI 對藝術創作的影響。

LeCun 對開源 AI 的支持反映了一種更廣泛的趨勢,即朝着更開放、合作和用戶驅動的 AI 發展方向前進。AI 是世界發展的趨勢,開源能加速技術發展。當大模型成為通信結構的重要組成部分,每個人都需要有一個通用的基礎設施。

AI 會模仿藝術作品,但無法創造出偉大的藝術作品,因為就像音樂不僅僅是聽覺體驗一樣,藝術所觸動我們的在於其背後的真實性,這是一種深刻的文化體驗。

01 前言

作為當代 AI 領域的先鋒以及 Meta 公司的首席 AI 科學家,LeCun 始終是這一技術領域最堅定的支持者之一。他從不掩飾對那些預測人工智能會導致人類滅絕等充滿強烈誤導色彩的信息的不屑,在社交媒體上,他經常發表尖銳的評論,炮轟那些散布恐懼情緒的人。

而當他的前同事 Geoffrey Hinton 和 Yoshua Bengio 在一份署名在頁面頂部的聲明 中將 AI 描述為“社會規模的風險”時,LeCun 並沒有選擇跟隨他們的步伐。相反,他給美國總統 Joe Biden 寫了一封公開信,呼籲敦促擁抱開源人工智能,並強調這種技術“不應被少數企業所垄斷”。

LeCun 的觀點在業界是不容忽視的。他與 Hinton 和 Bengio 推動了 AI 領域發展至關重要的技術——深度學習,三人也因此共同獲得了計算機科學領域的最高榮譽圖靈獎。2013 年,當 Meta(當時稱為 Facebook)邀請他成為 Facebook AI 研究實驗室(FAIR)的創始主任時,這個事件在當時還被視為 Meta 公司的一次重大進展。他同時也是紐約大學的教授。

近日,LeCun 說服了 CEO Mark Zuckerberg 將 Meta 的部分 AI 技術開源。就在 2023 年夏天,Meta 推出了一款名為 Llama 2 的開源大型語言模型,與來自 OpenAI、Microsoft 和 Google 等“少數企業實體”的大型語言模型展開競爭。一些批評者警告稱,這種開源策略可能會讓不法分子修改代碼,移除預設在 LLM 中的用於最小化 種族歧視性內容和其他有害輸出的安全措施。而作為 AI 領域最知名的樂觀主義者之一,LeCun 堅信人類有能力應對這些挑戰。

今年秋天,Steven Levy 在紐約曼哈頓 Meta 的辦公室與 LeCun 會面,兩人討論了開源技術,為什麼他認為 AI 的危險被誇大了,以及計算機是否能夠像查理·帕克那樣用薩克斯獨奏觸動人心。(Sense 說:LeCun 在巴黎郊外長大,他經常光顧紐約的爵士俱樂部。)12 月,我們在新奧爾良舉行的年度 NeurIPS 會議期間再次進行了討論。這次採訪為確保內容的簡潔和清晰,已經經過細緻的編輯。

02 訪談全文

當前的技術無法僅通過擴大規模就達到人類智能

Steven Levy:在最近的一次演講中,你談到“機器學習很糟糕。”為什麼你會這麼說?

Steven Levy 同時是著名搖滾雜誌《滾石》的撰稿人

Yann LeCun:機器學習非常出色。但僅僅依靠擴大我們現有技術的規模,就能實現與人類水平相當的 AI 嗎?這是不可能的。我們還缺少一些關鍵要素,才能使機器像人類和動物那樣高效地學習。但是我們目前還不清楚那些確切的要素是什麼。

我並不是在貶低這些大模型,或是說它們毫無用處。畢竟,我已將職業生涯都奉獻給了它們。但是我們需要對這個領域的過度熱情保持警惕。僅僅通過擴大規模,是不可能很快實現真正的 人類智能,這一點必須明確。

Sense說:

Steven Levy 是一位美國記者和作家,也是《連線》 (Wired) 雜誌的特約編輯。他被《華盛頓郵報》稱為“美國首席科技記者”。Levy在計算機、技術、密碼學、互聯網、網絡安全和隱私等領域撰寫了大量作品,是《黑客: 計算機革命的英雄》等多部著作的作者。他最近的著作《Facebook: 內部故事》通過對 Facebook 員工(包括 Chamath Palihapitiya.Sheryl Sandberg 和 Mark Zuckerberg 等知名人士) 長達三年的採訪,詳細描述了 Facebook 的歷史和崛起。Levy 在科技新聞領域享有很高的聲譽,對科技行業的理解做出了重要貢獻。

Steven Levy:你似乎覺得有責任揭露這些問題。

Yann LeCun:那是當然。AI 將給世界帶來巨大福祉,但是目前,部分人正利用了大眾對 AI 技術的恐懼心理,而讓我們不得不面臨着大眾會因此逃避使用 AI 的風險。而這也是人類在使用其他徹底改變世界的技術時所犯的錯誤。例如,15 世紀的活字印刷術,當時天主教會極力反對這一技術,他們擔心人們能因此直接閱讀聖經,而不再需要依賴神父。當時幾乎所有的機構都反對印刷術的普及,因為這將改變現有的權力結構。雖然他們的擔憂並非沒有道理——印刷術的確引發了長達 200 年的宗教衝突。但同時,它也催生了啟蒙運動的興起。

歷史學家可能指出,教會實際上也利用印刷術達到了自己的目的,但這不是討論的重點。

Steven Levy:為什麼科技界的許多傑出人物都對 AI 抱有警惕呢?

Yann LeCun:有些人是為了吸引公眾注意,而另一些人對目前的實際情況並不了解。他們沒有意識到 AI 實際上正在幫助減少 仇恨言論、虛假信息和破壞選舉系統的宣傳活動 等風險。在 Meta,我們利用 AI 極大地提高了處理這些問題的能力。五年前,Facebook 刪除的仇恨言論中,大約只有 20% 到 25% 是在人們看到之前由 AI 系統自動處理的。而去年,這一比例已經達到了 95%。

“AI 將為世界帶來許多好處,但我們也在面臨着人們因恐懼而迴避使用它的風險。”

開源 AI 與初衷

Steven Levy:你如何看待 chatbots?它們有能力取代人類的工作嗎?

Yann LeCun:chatbots 的進步令人吃驚,它們在一定程度上普及了創造力,能夠生成流暢且風格優良的文本。但它們的創意往往有限,生成的內容常常脫離實際。

Steven Levy:貴公司似乎相當熱衷於將 chatbots 融入進產品中。

Yann LeCun:我們所期望的是,在未來我們與数字世界乃至彼此之間的所有互動,都將通過 AI 來實現。因此,我們會試驗那些目前還不夠完善但正逐步接近這個目標的技術,比如你可以在 WhatsApp 上使用的聊天機器人,或者那些能在日常生活中協助你創作文本和實時翻譯的工具,甚至是在元宇宙中能發揮作用的工具。

Steven Levy:馬克·扎克伯格在 Meta 推廣 AI 的過程中扮演了什麼角色?

Yann LeCun:馬克非常积極,今年初,我向他展示了我剛才提到的願景:未來所有的互動都將通過 AI 來實現。ChatGPT 展示了 AI 可以比我們預期更早地用於開發新產品。公眾對 AI 能力的熱情也遠超我們的預期。因此,他決定成立一個專門致力於生成式 AI 的產品部門。

Steven Levy:為什麼 Meta 決定開源 Llama?

Yann LeCun:開源的大模型能夠吸引更多人參與,從而加速技術進步,這樣的系統更安全,性能更佳。想象一下,如果我們與数字世界的所有互動都由 AI 系統中介,你肯定不希望這個系統僅由美國西海岸的幾家公司控制。也許美國人不在意,但歐洲人絕不會接受。他們會質疑:“這系統說英語沒問題,那法語、德語、匈牙利語或荷蘭語呢?你是怎麼訓練它的?它能夠反映我們的文化嗎?”

Steven Levy:這似乎是一個很好的策略,既能讓初創公司使用你們的產品,又能在一定程度上削弱競爭對手。

Yann LeCun:我們不需要削弱任何競爭對手,這是世界發展的趨勢。AI 必須是開源的,因為當大模型成為通信結構的重要組成部分時,我們都需要有一個通用的基礎設施。

Yann LeCun預計,“我們與数字世界的所有互動——甚至包括我們之間的互動——都將由AI作為媒介進行。”

Steven Levy:OpenAI 這家公司的想法與眾不同,但你好像並不怎麼喜歡他們。

Yann LeCun:最初,他們打算作為一個非盈利機構進行 AI 研究,意在與 Google 和 Meta 這樣的行業巨頭形成一種平衡。我一開始就對他們的這一想法持保留態度,而事實證明,我的擔憂不無道理。OpenAI 如今已不再像最初那樣開放。相比之下,Meta 一直保持着較高的開放性。我之前提到過,如果沒有充足的資金支持,進行深入的 AI 研究幾乎是不可能的。結果,OpenAI 不得不轉型為盈利機構,並接受了微軟的投資。現在,他們基本上成了微軟的一個合作研究機構,儘管他們依然保持着一定的獨立性。此外,OpenAI 堅信 AGI 即將成為現實,並對他們將是首批研發成功的團隊非常自信。然而,我認為這是過於樂觀的。

Steven Levy:對於 OpenAI 的這場變故,Sam Altman 被撤下 CEO 職位然後又以不同身份回歸,你怎麼看?你認為這對研究界或行業有什麼影響?

Yann LeCun:我覺得研究界對 OpenAI 的興趣似乎已經減弱。他們不再像以前那樣公開發布研究成果,也很少透露他們目前的工作內容。我有幾位曾經的同事和學生在 OpenAI 工作,他們對那裡目前的不穩定局面感到不安。研究工作需要一個穩定和開放的環境,而目前的 OpenAI 顯然已經失去了這一優勢。所以,OpenAI 在研究界的形象已經發生了變化,他們不再被視為研究社區的重要貢獻者,這一角色已經由其他更開放的平台接替。

Steven Levy:有人認為 OpenAI 的這些變化實際上是AI“加速主義”的勝利。你自己不是悲觀主義者,但你認同加速主義嗎?

Yann LeCun:我不喜歡這些標籤,我不認同任何這類的思想流派或者學說。我也不會評價這類觀點,因為那樣很容易陷入極端主義,犯下愚蠢的錯誤。

AI 安全與政策制定

Steven Levy:歐盟最近發布了一系列 AI 法規,其中一個重要內容是對開源模型給予了一定的空間,使得可以免於部分規則的限制。這對 Meta 和其他公司會有什麼影響?

Yann LeCun:我們有足夠的實力來遵守任何法規。其實,對於那些沒有能力自行開發 AI 系統的國家來說,這個法規更為重要。他們可以利用開源平台來開發符合自己文化、語言和興趣的 AI 系統。在不久的將來,我們與数字世界的大部分甚至所有互動可能都將通過 AI 來實現。我們當然不希望這些系統只受制於加州的少數幾家公司。

Steven Levy:你是否參与了這個決策的制定過程?

Yann LeCun:我確實參与了,但不是直接與監管機構合作。我一直在與各國政府交流,特別是法國政府,同時也間接地向其他國家保持溝通。一個我們之間建立起的共識是:不應該讓少數人控制國民的数字生活。法國政府很早就想通了這一點。可惜的是,我沒有直接與歐盟層面的決策者交流,他們因為更多地受到了悲觀預測的影響而希望通過嚴格的監管來防範他們認為的可能發生的災難。但法國、德國和意大利政府並沒有這麼做,他們堅持為開源平台提供特殊的規定。

Steven Levy:但是,控制和規範開源 AI 真的有那麼難嗎?

Yann LeCun:並不。對於那些涉及安全的重要產品,已經有了相應的法規。比如,如果你要使用 AI 來設計新葯,就已經有法規來確保產品的安全性。我覺得這是合理的。對 AI 的研究和開發進行監管我覺得沒有必要。

“我們不希望讓少數人控制國民的数字生活。”

Steven Levy:有人會擔心,大公司發布的開源技術可能被別有用心的人利用,比如不法分子可能會利用它們去實現破壞性目的。

Yann LeCun:要做到這一點,他們需要能夠秘密使用 2000 個 GPU,有足夠的資金支持,還需要相應的專業能力。

Steven Levy:一些國家似乎有能力做到這一點。

Yann LeCun:連中國也做不到,因為存在貿易禁令。

Steven Levy:我認為他們最終會找到自主研發AI芯片的方法。

Yann LeCun:確實有可能。但他們在技術上會落後於最先進的水平幾年。技術進步的歷史就是這樣,每當技術發展,你都無法阻止不法分子獲取它。之後就是好的 AI 與壞的 AI 的較量。保持領先的方法是不斷進步,而快速進步的途徑是開放研究,讓更廣泛的社區為之貢獻力量。

Steven Levy:你是如何定義 AGI 的?

Yann LeCun:我不喜歡“AGI”這個術語,因為實際上並不存在所謂的“通用智能”。智能不是一個可以線性測量的概念。不同類型的智能實體具有不同的技能集合。

Steven Levy:一旦我們的計算機達到了與人類相當的智能水平,它們不會就此停步。憑藉深厚的知識、卓越的數學能力和更先進的算法,它們將創造出超級智能,對吧?

Yann LeCun:確實如此,機器最終將超越人類智能,這一點毫無疑問。不過我們無法預測這需要多長時間——可能是幾年,也可能是幾個世紀。

Steven Levy:到那時,我們是否必須做好準備?

Yann LeCun:不必。屆時,我們每個人都會擁有 AI 助手,就像擁有一支由超級聰明的人組成的團隊一樣。他們雖然不是真正的人類,但能幫助我們工作。人們可能會對此感到恐慌,但實際上,我們應該對此感到興奮。與比我更聰明的人一起工作,能夠擴展自己的能力,這是令人興奮的事情。

Steven Levy:但如果計算機發展到了超級智能,它們為什麼還需要我們呢?

Yann LeCun:我們沒有理由認為,僅僅是因為 AI 系統具有智能,它們就會想要統治人類。認為 AI 會像人類一樣有同樣的動機是一個誤解,而且我們也會設計它們以避免這種情況。

Steven Levy:如果人類沒有在 AI 中構建這些動機,超級 AI 是否會在盲目追求目標的過程中傷害人類呢?就像哲學家 Nick Bostrom 舉的例子,設計了一個不惜一切代價只製造回形針的系統,最終控制了整個世界以製造更多回形針。

Yann LeCun:構建一個系統卻不設置任何安全防護措施是極其愚蠢的。這就像造了一個有着千馬力引擎卻沒有剎車的汽車。在 AI 系統中設置動機是確保它們可控和安全的唯一方式,我稱之為“目標驅動 AI”。這是一種新型架構,但目前我們還沒有實際案例。

Steven Levy:這是你目前正在研究的方向嗎?

Yann LeCun:是。展開來說就是,AI 有其自己需要達成的目標,它不能產出任何與這些目標不符的成果。這些目標可能包括設置防護措施來防止潛在的危險等。

Steven Levy:你是否擔心你參与開發的 AI 將來會帶來不良後果?

Yann LeCun:如果我發現會有這樣的後果,我就會停止研究。

“沒有理由相信,僅僅是因為 AI 是智能的,它們就會想要統治我們。”

AI 作品是否有靈魂

Steven Levy:你對爵士樂情有獨鍾。AI 生成的作品能達到到目前為止只有人類能創造的那種精英級別、令人愉悅的創造力嗎?它能創作出有靈魂的作品嗎?

Yann LeCun:這個問題的答案比較複雜。在某種意義上,AI 系統最終會創作出技術水平與人類相當甚至更高的音樂作品——或是視覺藝術作品等。但 AI 系統還不具備即興音樂的精髓,即依靠人類傳達情感的能力。至少目前還沒有。這也是為什麼要聽爵士樂最好是去現場聆聽欣賞。

Steven Levy:那些音樂有靈魂嗎?

Yann LeCun:市面上已經存在了很多缺乏靈魂的音樂。這些音樂在餐館里作為背景音樂播放,它們更多是由機器製作的產品。而這類音樂也有其市場需求。

Steven Levy:但我指的是藝術的巔峰。如果我播放給你一段超越了 Charlie Parker 最佳水平的錄音,然後告訴你這是 AI 創作的,你會感覺受騙嗎?

Yann LeCun:會,因為音樂不僅僅是聽覺體驗,它在很大程度上是一種文化體驗。它包含了對表演者的欽佩。你的這個例子就像 Milli Vanilli 事件。真實性是藝術體驗中極其關鍵的部分。

Sense 說:

Milli Vanilli是一個在1980年代末和1990年代初著名的德國R&B和流行音樂組合。這個組合最初是由Fab Morvan和Rob Pilatus組成的。Milli Vanilli在音樂界迅速崛起,憑藉如《Girl You Know It's True》、《Blame It on the Rain》和《Girl I'm Gonna Miss You》等熱門單曲而廣受歡迎。

然而,Milli Vanilli最著名的可能是他們的職業生涯中的一個巨大丑聞。在達到頂峰后不久,他們被揭露實際上並沒有親自演唱他們的歌曲,而是在公眾面前假唱。這個醜聞震驚了娛樂界,導致他們被迫歸還了他們在1989年獲得的格萊美最佳新人獎。這個事件成為音樂史上最大的欺詐之一,並且對Milli Vanilli的職業生涯造成了毀滅性的打擊。之後,這個組合解散,其成員試圖在音樂界重建他們的聲譽,但只取得了有限的成功。

Steven Levy:如果 AI 系統足夠優秀,能夠匹配頂尖藝術成就,而你對此一無所知,市場上將充斥着像 Charlie Parker 那樣水平的音樂,我們也許無法分辨真偽。

Yann LeCun:我不認為這是個問題。我仍然會選擇原創作品,就像我願意花 300 美元購買一個擁有幾百年文化傳承的手工製作碗,即使我可以用 5 美元買到外觀幾乎相同的產品一樣。我們還是會去現場欣賞我最愛的爵士樂手,即使他們的音樂可以被 AI 模仿。AI 帶來的體驗是完全不一樣的。

Steven Levy:聽說最近你從 Macron 總統那裡獲得了一個獎項?

Yann LeCun:是的,Chevalier de la Légion d'honneur(榮譽軍團騎士勳章)。它由拿破侖創立,有點類似英國的騎士身份,但我們經歷過一場革命,所以我們不會稱呼人們為“ Sir ”。

Sense說:

Chevalier de la Légion d'honneur 是一種由拿破侖創立的榮譽勳章,類似於英國的爵位(knight)。不過,由於法國歷史上發生過革命,他們不像英國那樣使用“Sir”(爵士)這樣的稱號。換句話說,儘管這個榮譽與英國的爵位在地位上有所類似,但由於法國的歷史和文化背景,他們對這種榮譽的稱呼和看待方式有所不同。

Steven Levy:所以這個勳章還會贈予劍類的兵器嗎?

Yann LeCun:並沒有類似的物品,但是獲得者可以在西裝翻領上佩戴一條小紅條。

Steven Levy:AI 有一天能獲得這種獎項嗎?

Yann LeCun:我不認為這是一個好想法。

參考材料

https://www.wired.com/story/artificial-intelligence-meta-yann-lecun-interview/