所有語言

分享

擺脫OpenAI依賴!微軟組建王牌AI團隊專攻「小模型」,為大模型降本增效

原文來源:新智元

圖片來源:由無界 AI生成

根據消息人士曝料,微軟調集了各組中的精英,組建了一支新的AI團隊,專攻小模型,希望能夠擺脫對於OpenAI的依賴。

憑藉著和OpenAI的緊密合作,微軟不僅一躍成為了大廠中模型能力最強的公司,而且股價也成功趕上了蘋果,成為了世界上市值最高的公司之一。

但是,去年11月份OpenAI的鬧劇也讓微軟明白,如果把自己最重要的技術押寶在一家初創公司上,最後翻車的風險也是相當大的。

畢竟在商業世界里,「我能用」和「是我的」是兩個完全不同的概念。

達沃斯世界經濟論壇上,微軟⾸席執⾏官Nadella稱,在⼩型⼈⼯智能模型⽅⾯,微軟正在以⼀種 「掌控⾃⼰命運 」的⽅式取得突破。

納德拉說「我們⾮常重視擁有最好的前沿模型,⽽如今最前沿的模型恰好是GPT-4。同時我們也擁有最好的小語言模型--Phi,從而擁有了最強的多樣化的模型能力。」

而最近有外媒曝出,微軟正在組建一支自己的LLM嫡系部隊躬身入局,希望從「小模型」發力,讓微軟的肉身真正坐上「大模型之戰」的主桌。

根據微軟內部知情人士透露,微軟組建了一個名為「GenAI」的團隊,由公司副總裁Misha Bilenko領頭,直接向公司CTO Scott彙報。

Bilenko曾經是「俄羅斯百度」Yandex的人工智能研究主管,過去兩年裡他一直在領導Azure團隊,在微軟內部部署OpenAI的系統。

這個「GenAI」團隊的大部分成員,都是這兩年一直在微軟配合OpenAI團隊落地的Azure工程師。

除了這些有工程經驗的人員,微軟還調配了最頂級的AI研究人員加入這個團隊,包括Sébastien Bubeck帶領的微軟研究院的研究人員。

他們開發的Phi這種輕體量的模型,體積⼩到可以在移動設備上運⾏,但在某些任務上能夠逼近GPT-4的性能。

Phi團隊去年使⽤GPT-4⽣成了數百萬條⾼質量的⽂本,並在這些數據上對Phi進⾏了訓練,使其能夠模仿體量更⼤的模型進行輸出。

而除了微軟,谷歌,Stability AI等公司,也都推出了自己的「小模型」,希望能獲得低成本和移動設備上AI競爭的先發優勢。

高質量數據是小模型的關鍵

微軟在一個月前推出的Phi-2小模型,以不到3B的參數量,在很多測試集上跑到了Llama 2 70B的分數,着實把業界下了一跳。

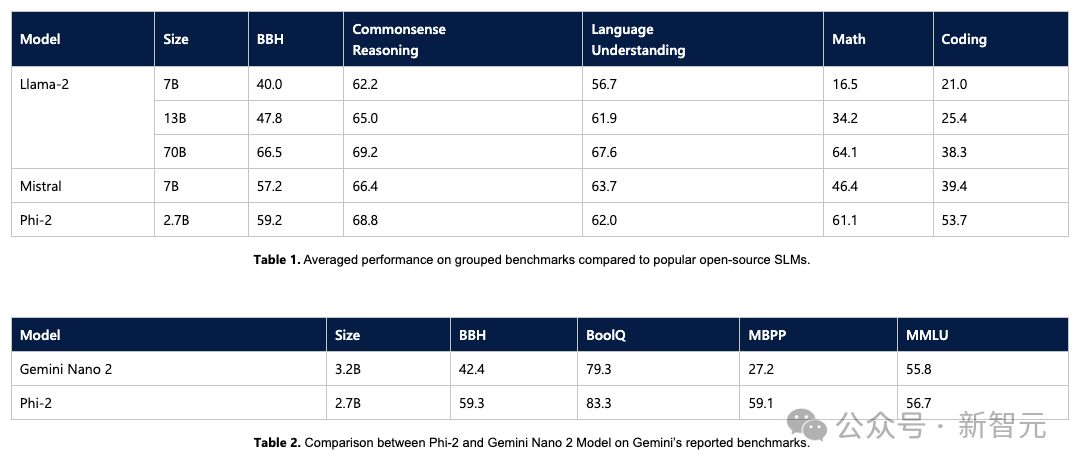

Phi-2隻有2.7B的參數,在各種基準上,性能超過了Mistral 7B和 Llama-2 13B的模型性能。

而且,與25倍體量的Llama-2-70B模型相比,它在多步推理任務(即編碼和數學)上的性能還要更好。

此外,Phi-2與谷歌最近發布的Gemini Nano 2相比,性能也更好,儘管它的體量還稍小一些。

微軟稱他們使用1.4T個token進行訓練(包括用於NLP和編碼的合成數據集和Web數據集)。

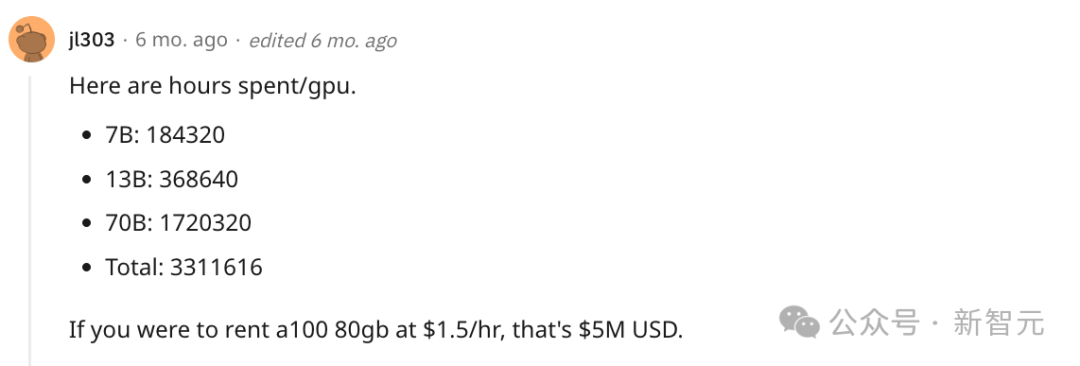

而且訓練Phi-2隻使用了96塊A100 GPU,耗時14天就完成了。

相比之下,Meta在去年中推出的Llama 2 70B,網友推算花了170萬 GPU/小時來訓練。

如果按96塊A100來算,需要746天。

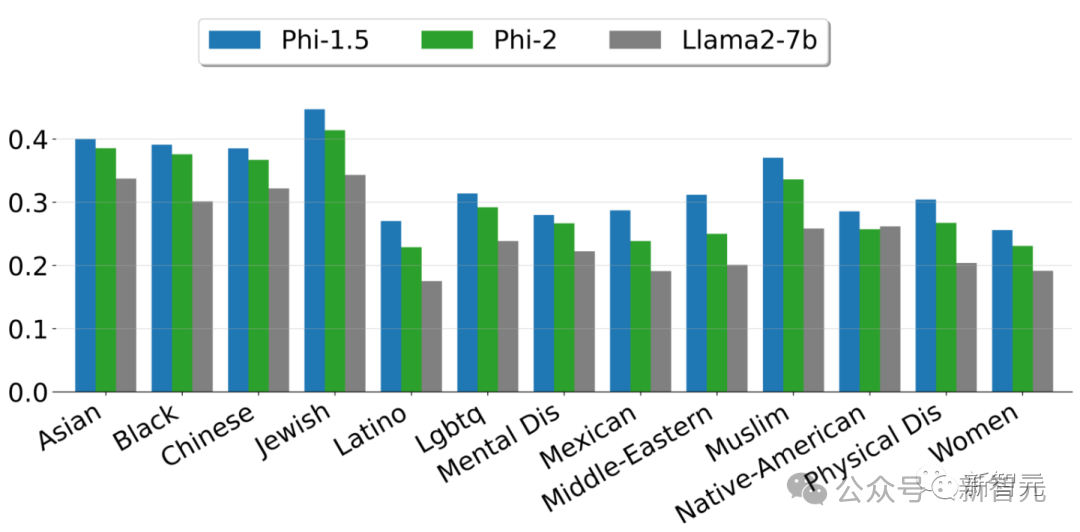

而且Phi-2是一個完全沒有經過微調和RLHF的基礎模型,與經過對齊的現有開源模型相比,Phi-2在毒性(toxicity)和偏見(bias)方面有更好的表現。——這得益於採用了量身定製的數據整理技術。

上圖展示了根據ToxiGen中的13個人口統計學數據,計算出的安全性分數。

可以說,之所以微軟要大力發展小模型,一個非常重要的原因是,他們找到了一條能夠在保證模型能力不受太大影響,但能有效降低模型參數的辦法。

大模型也要「降本增效」

微軟不但在訓小模型上很有「天賦」,而且做這件事本身也非常有價值的。

眾所周知,在GPU一卡難求的今天,要訓出能力超強的大模型,已經完全不是一個和投入有關的問題。

技術實力,算力限制等等都卡住了所有大廠的脖子。

而且即便獲得了能力最前沿的大模型,要把它和現有業務結合起來,成功的賺到錢,也是一件很難的事情。

大模型居高不下的推理成本,讓大公司們現在推出的AI工具基本上都是在「虧本賺吆喝」。

業界有一個非常有意思的比喻,用GPT-4來總結郵件就相當於開着蘭博基尼送外賣。

所以也就不奇怪為什麼有媒體曾經曝出,微軟的GitHub Copilot每個用戶平均每月要虧本20刀,因為大模型的推理成本實在太高了。

在代碼生成和補全這種高頻次調用模型的場景的下,廠商如果最終要靠服務賺錢,推理成本是必須要考慮的事情。

而模型越大,訓練的成本也就越高,推理成本更是成十倍甚至百倍規模地上升。

如果生成式AI的浪潮最後要能轉化成真正提高生產力的技術,讓推進的廠商實實在在賺到錢是非常重要的。

所以,在盡量保證模型能力不變的前提下,盡可能的減少模型的規模,是在經濟上找到出路的幾乎唯一的方式。

而在這個方向上,微軟已經走在了行業的最前端。

而且除了出於成本之外的考慮,數據隱私,在移動端部署等需求,也需要各大廠必須要有自己的「小模型」,才能滿足各種產品和服務的AI化需求。

參考資料:

https://www.theinformation.com/articles/microsoft-forms-team-to-make-cheaper-generative-ai?rc=epv9gi